Привет, незнакомец!

Похоже, вы здесь новенький. Чтобы принять участие, нажмите одну из кнопок ниже!

Важное и полезное!

Правила форума (важно!)

Концепция "Реальность"

Телега основателя

Телега основателяТурбосуслик:проработай!

Расшифровка рейв-карты

Ваша Матрица Судьбы

Ваша Матрица Судьбы

В социальных сетях

RealFAQ в Телеграм

RealFAQ в ТелеграмRealFAQ ВКонтакте

- 4.9K Все разделы

- 265 Работа с подсознанием

- 9 Техники Живорада Славинского

- 26 Турбо-Суслик

- 11 Аффирмации

- 3 Нейрографика П. Пискарева

- 23 Техники НЛП

- 38 Медитативные техники

- 8 Сенсорная депривация

- 10 Осознанные сны

- 34 Трансерфинг реальности

- 1.2K Дизайн Человека

- 90 Типы (Дизайн Человека)

- 36 Профиль (Human Design)

- 86 Центры (Human Design)

- 38 Каналы в Дизайне Человека

- 65 Ворота в Дизайне Человека

- 21 Планеты (Human Design)

- 39 Отношения в Дизайне

- 44 Цвет, Тон, База (ДЧ)

- 121 Инкарнационный крест

- 68 Гексаграммы И-Цзин

- 110 Генные ключи

- 358 Расшифровка карты

- 668 Астрологический форум

- 100 Читаем натальную карту

- 35 Знаки Зодиака

- 106 Планеты в астрологии

- 44 Аспекты планет

- 33 Дома в астрологии

- 55 Предсказательная астрология

- 44 Лунные узлы

- 49 Проработка в астрологии

- 41 Джйотиш-форум

- 12 Какие бывают гороскопы?

- 117 Нумерология

- 7 Акара-нумерология

- 23 Сакральная нумерология

- 78 Матрица судьбы

- 148 Всё о Таро

- 8 Старшие арканы Таро

- 0 Младшие арканы Таро

- 39 Расклады Таро

- 13 Обзор колоды

- 17 Портрет по Хшановской

- 13 Всё о рунах

- 194 Психологические типологии

- 35 Форум Анонимных Социоников

- 33 Психе-йога

- 10 5 травм по Лиз Бурбо

- 16 Типология Княжны

- 10 Системно-векторный психоанализ

- 25 Эннеаграмма личности

- 39 Типирование

- 59 Экзистенциально-Архетипическая Теория

- 21 Экзистенциальные страхи

- 30 12 архетипов

- 791 Форум по психологии

- 92 Психологические защиты

- 65 Психология детей и родителей

- 8 Психология поколений

- 106 Психология отношений

- 62 Психология эмоций

- 28 Гендерная психология

- 32 Психология животных

- 109 Психотесты

- 73 Бабло Человека

- 296 Физическое здоровье

- 14 Психосоматика

- 7 Энергетические меридианы человека

- 118 Приготовление пищи

- 6 Кетогенная диета

- 20 Чайный форум

- 12 Ароматерапия

- 5 Курение

- 18 Буха́ние

- 153 Наука и технологии

- 61 Форум по философии

- 592 Микрорецензии

- 389 Фильмы

- 68 Сериалы

- 13 Мультфильмы

- 61 Книги

- 23 Музыка

- 8 Компьютерные игры

- 152 Путешествия и жизнь в разных странах

- 29 Россия

- 16 Европа

- 34 Азия

- 6 Латинская Америка

- 24 Языки разных стран

- 508 Всё остальное

- 286 О нашем сообществе

Разделы

Теперь есть еще филиал форума в Телеграме - чат и канал "FAQ по реальности". Если вам удобнее Телеграм - можно общаться там тоже.

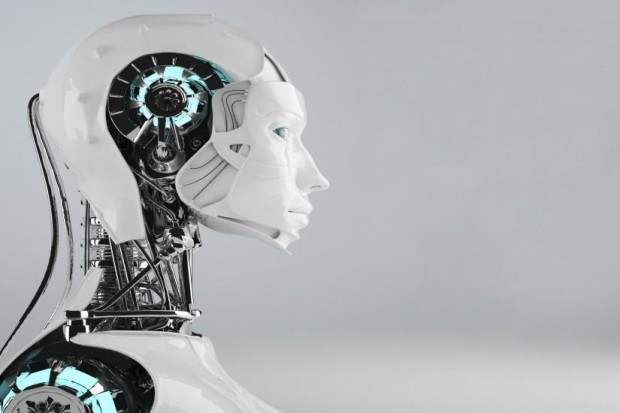

Искусственный интеллект психопата создали в США

Норман – так зовут нейросеть, вдохновленную маньяком с раздвоением личности Норманом Бейтсом – был создан специалистами по машинному обучению из Массачусетского университета.

Перед учеными стояла задача сделать Нормана психопатом, а не обычной нейросетью. Для этой цели поток получаемой им информации сводился к данным из подразделов сайта Reddit, где обмениваются фотографиями любители различной «жести». На фотографиях изображены люди, погибающие при жутких обстоятельствах, или разрушения. По этическим соображениям, что именно запечатлено на фотографии, Норман не видел: ему была доступна лишь подпись к картинке и размытое изображение, скорее, напоминающее кляксу. Таким образом и была сформирована мрачная картина мира Нормана.

Исследователи провели опыт над «нормальной» нейросетью, стандартно воспринимающей мир положительно, и Норманом при помощи теста Роршаха. Этот тест был разработан швейцарским психиатром Германом Роршахом в прошлом веке: человеку предлагалось 10 изображений симметричных клякс, которые он должен был интерпретировать. Роршах и его единомышленники полагали, что на основе полученных ассоциаций можно сделать вывод о психическом состоянии человека. И если обычная нейросеть видела в кляксах вазу с цветами, птиц и животных, то Норман видел человека, которого пытают током, или прыгающего из окна.

Ученые свели с ума нейросеть не для демонстрации пагубного влияния интернета на психику человека, ведь у Нормана нет никаких моральных установок или побуждений, в отличие от человека. Данный опыт показывает, как искусственный интеллект легко может приобрести опасные предрассудки и концепции. На сегодняшний день актуальной и важной задачей является тренировка нейросети и крайнее внимание к поглощаемым данным. Особенно стоит понимать, что допуск в даркнет может приводить к различным пагубным последствиям. Это не значит, что ИИ начнет убивать и насиловать (на данный момент у него нет такой возможности), но вот принять неверное решение исходя из своего обучения – вполне вероятно.

ИИ получил широкое распространение, на которое мы, порой, не обращаем внимания: от камер, способных найти преступника в любой точке мира, до голосовых помощников, которых оставляют с детьми. С одной стороны ИИ упрощает жизнь, но так ли он безопасен и дружелюбен? К примеру, алгоритм, использующийся в одном из судов США для определения степени риска при освобождении задержанных под залог, предвзято относился к людям с темным цветом кожи. Искусственный интеллект был уверен, что темнокожие люди совершают повторные преступления в два раза чаще из-за неполной выборки информации, на которой он обучался.

Профессор Массачусетского университета Ияд Рахван считает, что Норман – одна из самых ярких демонстраций фундаментальных проблем процесса машинного обучения. Профессор заявляет, что набор исходных данных важнее самого алгоритма. Полученные данные способны менять восприятие мира искусственным интеллектом. Будет ли это реальной проблемой и опасностью или ученые найдут выход – пока неизвестно.

Источник

Войдите или Зарегистрируйтесь чтобы комментировать.

realfaq.NET - зеркало форума, где он будет доступен в случае причуд регулирования интернета в РФ

Копирование материалов разрешается только с указанием прямой активной ссылки на источник!

Телега основателя

Телега основателя Ваша Матрица Судьбы

Ваша Матрица Судьбы

Комментарии